Le paradoxe de productivité

Un directeur des soins qui consacre vingt heures à affiner une séquence de prompts pour synthétiser les données médico-économiques de ses pôles sait qu'il a construit quelque chose. Un DRH qui a calibré, itération après itération, un workflow de rédaction de fiches de poste assisté par l'IA générative le sait aussi. Chacun mesure le gain : ce qui prenait trois jours se fait désormais en une demi-journée.

Ce qu'aucun des deux ne mesure, c'est la fragilité de ce gain. Car le prompt affiné, la séquence de travail rodée, le contexte métier patiemment injecté dans la mémoire de l'outil ne sont protégés par rien. Pas de sauvegarde. Pas de versionnage. Pas de procédure de transmission. Si la session est corrompue, si le fournisseur change de modèle, si l'agent qui a construit le workflow quitte l'établissement — le capital disparaît.

La théorie de la charge cognitive, formalisée par Sweller dès 1988, éclaire rétrospectivement ce qui se joue. Les LLM externalisent une part significative de la charge extrinsèque qui pesait sur les professionnels : recherche documentaire, structuration d'informations, rédaction de synthèses. Cette externalisation est réelle et mesurable. Mais elle crée un actif d'un genre nouveau — ni document, ni logiciel, ni procédure au sens classique — qui échappe aux catégories habituelles de la gestion de l'information.

L'IA réduit et crée de la charge cognitive simultanément

Un essai contrôlé randomisé publié en janvier 2025 dans le Journal of Medical Internet Research illustre ce paradoxe avec précision. Tsai et ses collègues ont montré que des pharmaciens assistés par l'IA déplaçaient 19 à 26 % de leurs fixations visuelles vers les zones générées par le système — preuve d'une intégration réelle de l'aide dans leur processus de décision. Mais lorsque l'aide s'avérait peu fiable, les temps de traitement cognitif augmentaient significativement. Et lorsque le système affichait son degré d'incertitude — mécanisme pourtant recommandé pour la transparence —, la charge cognitive s'alourdissait encore.

Le constat dépasse le contexte pharmaceutique. Macrae, dans une étude qualitative publiée en 2024 dans Risk Analysis à partir de quarante entretiens avec des développeurs, gestionnaires et régulateurs de l'IA en santé, identifie ce qu'il nomme des « dépendances de vigilance » : l'IA crée de nouvelles exigences d'attention soutenue pour les cliniciens, et peut encombrer les processus décisionnels si elle n'est pas intégrée de manière réfléchie.

Ce que ces travaux convergent à montrer, c'est que le professionnel qui construit des workflows IA sophistiqués ne se contente pas d'utiliser un outil. Il construit une architecture cognitive — un dispositif sur mesure, calibré sur ses données, ses contraintes, son registre professionnel — dont la valeur augmente avec le temps et l'usage. Cette architecture est le capital cognitif augmenté.

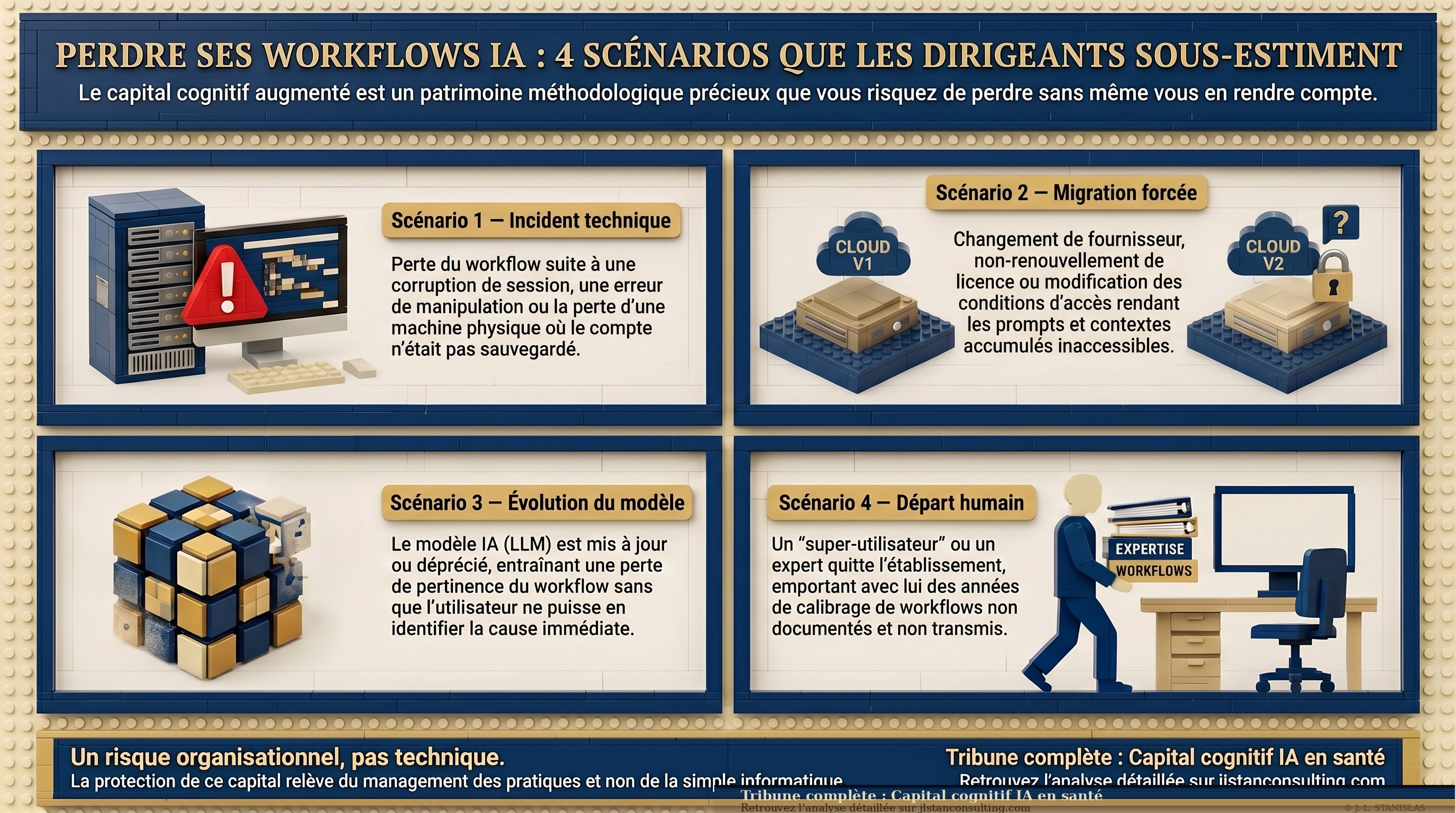

Quatre scénarios de perte

En contexte hospitalier, la perte de ce capital peut survenir par quatre chemins distincts. Un incident technique d'abord : corruption de session, erreur de manipulation, perte de machine — le workflow n'existait que dans un compte utilisateur non sauvegardé. Une migration procédurale ensuite : la DSI impose un changement d'outil, la licence n'est pas renouvelée, le fournisseur modifie ses conditions d'accès — les prompts et contextes accumulés deviennent inaccessibles. Un changement de modèle également : le LLM sur lequel les séquences avaient été calibrées est déprécié ou modifié en profondeur — le workflow perd en pertinence sans que l'utilisateur comprenne immédiatement pourquoi. Un départ humain enfin : l'agent qui avait construit le dispositif quitte l'établissement sans transmission structurée — deux ans de calibrage partent avec lui.

Aucun de ces scénarios n'est théorique. Chacun se produit déjà dans les établissements qui ont engagé une démarche d'acculturation à l'IA générative. La différence avec un incident informatique classique, c'est que la perte est invisible : personne ne reçoit d'alerte, aucun système ne tombe, aucun indicateur ne vire au rouge.

L'angle mort des cadres existants en établissement de santé

Le guide HAS « Premières clefs d'usage de l'IA générative en santé », publié en octobre 2025 et structuré autour des lignes directrices A.V.E.C. (Apprendre, Vérifier, Estimer, Communiquer), constitue une avancée notable pour l'encadrement des usages. Il traite de la transparence, de la fiabilité des contenus générés, des risques liés à la confidentialité des données. Le guide conjoint HAS-CNIL publié en mars 2026 renforce ces orientations en insistant sur la protection des données et la responsabilité des professionnels.

Ces cadres sont nécessaires. Mais ils partagent un même point aveugle : aucun ne pose la question de la continuité du patrimoine méthodologique construit par les professionnels. Le bon usage est traité. La qualité de l'interaction est traitée. Le risque de fuite de données est traité. Ce qui n'est pas traité, c'est la question : « Que se passe-t-il si vous perdez ce que vous avez mis des mois à construire avec l'IA ? »

Du côté de la continuité d'activité, le constat est symétrique. Les PCA/PRA des établissements, renforcés par le programme CaRE et l'arrêté du 3 juillet 2025, couvrent l'infrastructure SI, la cybersécurité, la reprise des systèmes critiques. Ils ne couvrent pas le capital cognitif augmenté — les prompts, les contextes, les règles de sourcing, les séquences de travail construites agent par agent. Aujourd'hui, aucun PCA ne cartographie explicitement les workflows IA critiques, au même titre que les applications métier ou les SI vitaux.

Angle mort identifié : les cadres de gouvernance IA traitent l'usage. Les PCA/PRA traitent l'infrastructure. Personne ne traite le patrimoine méthodologique construit entre les deux — celui que les professionnels bâtissent quotidiennement, sans cadre ni filet.

Ce qui se joue maintenant

Le capital cognitif augmenté par l'IA n'est pas un sujet DSI. C'est un sujet de management des pratiques professionnelles, qui relève du directeur général, du DRH, du directeur qualité, du président de CME. Car ce qui est en jeu, ce n'est pas un risque technique — c'est un risque organisationnel : la concentration de savoirs critiques dans des dispositifs personnels non transmissibles, non documentés, non protégés.

Trois questions que toute direction d'établissement engagée dans l'IA générative devrait se poser aujourd'hui : Où sont stockés les prompts et les workflows IA de vos équipes ? Qui les détient ? Que se passe-t-il s'ils disparaissent ?

Si vous ne pouvez pas répondre, vous avez identifié une zone de vulnérabilité que ni votre PCA ni votre démarche de gouvernance IA ne couvrent encore. C'est un chantier à ouvrir — et il est urgent, parce que chaque semaine qui passe ajoute de la valeur dans des dispositifs que personne ne protège.

Une fiche méthode suivra, avec une grille de diagnostic et un plan d'action en quatre briques pour structurer la continuité de ce capital. En attendant, la première étape est de nommer le phénomène — ce que cette tribune vient de faire. Elle est le prolongement de dix années d'accompagnement d'équipes hospitalières sur le terrain de la gouvernance et de l'acculturation numérique.

À lire aussi — Publications WEKA Santé

Accès réservé aux abonnés WEKA Santé · Voir toutes mes publications →

Références

Sweller, J. (1988). Cognitive load during problem solving: Effects on learning. Cognitive Science, 12(2), 257-285.

Tsai, C.C. et al. (2025). Effect of Artificial Intelligence Helpfulness and Uncertainty on Cognitive Interactions with Pharmacists: Randomized Controlled Trial. J Med Internet Res, 27, e59946. DOI : 10.2196/59946

Macrae, C. (2024). Managing risk and resilience in autonomous and intelligent systems. Risk Analysis, 45(4), 910-927. DOI : 10.1111/risa.14273

HAS (2025). Premières clefs d'usage de l'IA générative en santé. Décision n°2025.0238.DC.MNS du 23 octobre 2025.

HAS & CNIL (2026). Accompagner le bon usage des systèmes d'intelligence artificielle en contexte de soins. Guide HAS-CNIL, mars 2026.

Ministère de la Santé / DNS (2024-2028). Programme CaRE — Cybersécurité, Accélération et Résilience des Établissements de santé. Arrêté du 3 juillet 2025.